张梅山老师在自然语言处理领域研究情况介绍

2019-05-31

张梅山老师目前主要从事自然语言处理和机器学习的研究工作,尤其中文词法句法分析、情感分析以及它们与深度学习的结合,并在自然语言处理领域的知名国际期刊和国际会议(CCF A与B类)上包括TASLP、ACL、EMNLP、COLING、AAAI和IJCAI等发表论文20多篇,承担国家级项目3项。 具体研究成果主要包括:

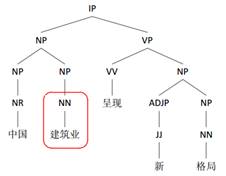

1.中文基础语言分析技术,包括中文分词,词性标注,句法分析等任务。如下图所示例子,给定一段原始文本“中国建筑业呈现新格局”,中文分词将句子切割成词序列,形成“中国 建筑业 呈现 新 格局”;进一步词性标注为每个词标注词的属性,比如NR表示专有名词,NN表示普通名词,VV表示动词,JJ表示形容词;然后句法分析用于解析句子结构信息,比如“中国 建筑业”形成一个名词短语NP,而“呈现 新 格局”表示一个动词短语VP,名词短语和动词短语组合成一个句子。

相关论文:

● Chinese Parsing Exploiting Characters (ACL 2013)

● Character-Level Chinese Dependency Parsing (ACL 2014)

● Transition-Based Neural Word Segmentation (ACL 2016)

● Segmenting Chinese Microtext: Joint Informal-Word Detection and Segmentation with Neural Networks (IJCAI 2017)

● A Simple and Effective Neural Model for Joint Word Segmentation and POS Tagging (TASLP 2018)

2. 面向社会媒体的文本情感分析。如下图所示,给定一段评论意见句,挖掘评论短语“非常满意”和“比较高”,判断其极性正面(+),然后为每个评价短语分析其意见持有者(is-from)和意见对象(is-about)以及意见原因(is-reason)。

相关论文:

● Neural Networks for Open Domain Targeted Sentiment (EMNLP 2015)

● Gated Neural Networks for Targeted Sentiment Analysis (AAAI 2016)

● Context-Sensitive Twitter Sentiment Classification Using Neural Network (AAAI 2016)

● Improving Twitter Sentiment Classification Using Topic-Enriched Multi-Prototype Word Embeddings (AAAI 2016)

● End-to-End Neural Opinion Extraction with A Transition-Based Model (Information Systems 2019)

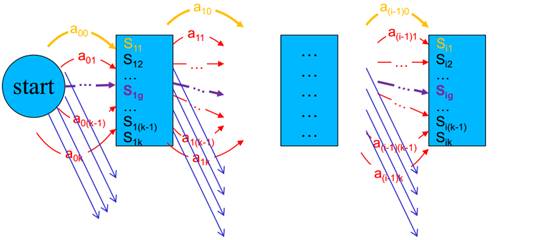

3. 基于转移的端到端结构学习模型。自然语言处理的任务,例如词法分析、句法分析、细粒度文本情感分析等,其输出一般为序列或者树图结构,这一类任务又称为结构预测任务。基于转移的结构学习算法将这类结构预测任务转换成为序列到序列(Sequence-to-Sequence)的问题,将任务解码变成一系列动作序列,并结合柱搜索和全局优化算法,如下图所示,其中a为动作,柱大小为k。任何结构预测任务均可以用这一统一的框架进行建模,并且其性能也能具有很强的竞争能力,达到目前领先水平。

相关论文:

● A Transition-based Model for Joint Segmentation, POS-tagging and Normalization. (EMNLP 2015)

● Transition-Based Neural Word Segmentation (ACL 2016)

● End-to-End Neural Relation Extraction with Global Optimization (EMNLP 2017)

● Transition-based Neural RST Parsing with Implicit Syntax Features (COLING 2018)

● End-to-end neural opinion extraction with a transition-based model (Information Systems 2019)

4. 深度学习框架。深度学习模型的搭建离不开一个好的框架,当前比较成熟的框架包括Tensorflow, Pytorch, MXNet, Caffe等。我们也可以针对自然语言的任务搭建一个框架,使得深度学习模型的创建和训练更有效率,为此,我们提出了一种基于动态图生成的轻量级的深度学习框架。

相关论文:

● LibN3L: A Lightweight Package for Neural NLP. (LREC 2016)

● N3LDG: A Lightweight Neural Network Library for Natural Language Processing. (北京大学学报,2019)

微信公众号